ResNet

Deep Residual Learning for Image Recognition

深度残差网络,将CNN拓展到152层乃至更深层,同时表现出更好效果的里程碑文章。核心是将residual connection代入到深层CNN中,使得深层的模型效果不比浅层的模型效果差。

深度残差网络,将CNN拓展到152层乃至更深层,同时表现出更好效果的里程碑文章。核心是将residual connection代入到深层CNN中,使得深层的模型效果不比浅层的模型效果差。

ICML 2021

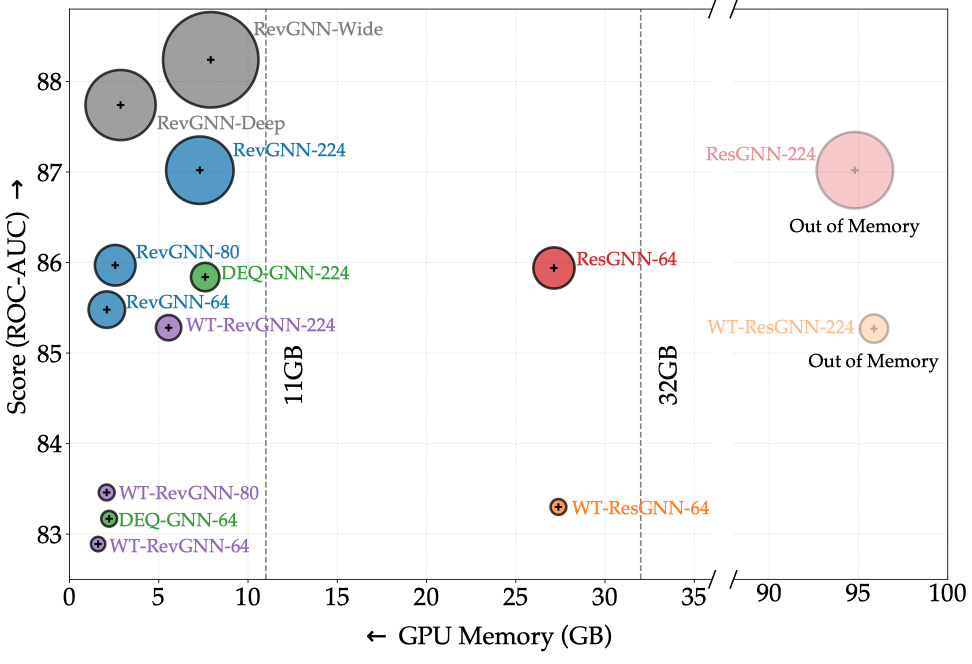

这篇文章通过在GNN中引入grouped reversible connections,实现了将GNN拓展到1000层,可能是当前最深的GNN之一。这篇文章的意义在于,实现了GNN的层数与模型所需的显存无关,使用较少的显存就可以在显存基本不增加的情况下,任意增加GNN深度。

下图是作者提出的Rev-GNN在ogbn-proteins数据集上的结果,很少的memory,达到了很好的效果。

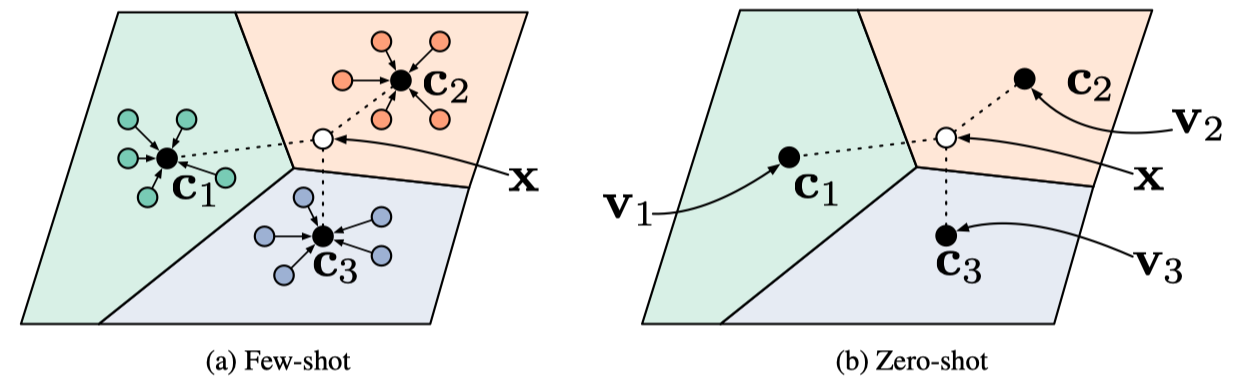

作者为少次学习和零次学习提出了一种新的网络Prototypical network。核心思想是为不同的class定义不同的prototype的表示。这个prototype是有相同class下的所有实例求平均得到的。

好的句子收集

《算法笔记》第二章 C/C++快速入门。这里记录些要点。

C语言常包括头文件<stdio.h>,stdio是标准输入输出的意思。实际上,在c++标准中,推荐使用<cstdio>,cmath和cstring等头文件,和.h结尾的头文件是等价的。